Материалы по тегу: периферийные вычисления

|

27.05.2024 [09:09], Сергей Карасёв

Simply NUC представила мини-ПК extremeEDGE ServerКомпания Simply NUC анонсировала устройства семейства extremeEDGE Server, предназначенные для выполнения различных задач на периферии. Фактически это мини-серверы, которые в зависимости от модификации несут на борту процессор AMD или Intel и поддерживают различные средства проводного и беспроводного подключения к сети. Особенностью устройств является технология NANO-BMC. Модуль BMC, или Baseboard Management Controller, контролирует работу платформы и выполняет ряд важных функций, таких как управление питанием, мониторинг датчиков, возможность удалённого обновления прошивки, регистрация событий и пр. В случае extremeEDGE Server технология NANO-BMC помогает организовать вычисления на периферии. Новое семейство включает три серии: extremeEDGE 1000 для IoT-шлюзов и военных приложений, extremeEDGE 2000 для приложений ИИ и промышленной автоматизации, а также extremeEDGE 3000 для критически важных развёртываний в суровых условиях.

Источник изображения: Simply NUC Решения extremeEDGE 1000 комплектуются чипом Intel Celeron N5105 или Intel Processor N100; максимальный объём оперативной памяти составляет 32 Гбайт. Вместимость накопителя в зависимости от версии — 2 или 8 Тбайт. Присутствуют два порта 2.5GbE и дополнительный порт 1GbE BMC. Для некоторых вариантов в качестве опций доступны контроллер Wi-Fi и модем 4G. Имеются интерфейсы HDMI, USB 3.2 Type-A и USB Type-C 2.0. Устройства extremeEDGE 2000, в свою очередь, несут на борту процессор AMD V3C18I, Ryzen 7 7840U или Ryzen 7 Pro 8840U. Максимальный объём оперативной памяти — 96 Гбайт. Есть возможность установки двух SSD формата М.2 2280; ёмкость подсистемы хранения данных — до 16 Тбайт. Присутствуют два порта 2.5GbE и порт 1GbE BMC. Старшие модификации также наделены двумя разъёмами 10GbE SFP+. В качестве опций предлагаются поддержка PoE+ и установка дополнительного ИИ-ускорителя. Решения серии extremeEDGE 3000 предлагают такой же выбор процессоров, что и extremeEDGE 2000. Объём ОЗУ достигает 96 Гбайт. Подсистема хранения данных может объединять три SSD формата М.2 2280 и один модуль М.2 2242: суммарная вместимость — до 26 Тбайт. Упомянуты контроллеры Wi-Fi 6E и Bluetooth 5.3, модем 4G/5G (Dual SIM), четыре порта 2.5GbE и порт 1GbE BMC. У старших моделей есть два разъёма 10GbE SFP+. Диапазон рабочих температур простирается от -40 до +85 °C.

25.05.2024 [20:50], Сергей Карасёв

EdgeCortix представила ИИ-ускоритель SAKURA-II Edge AI с производительностью до 60 TOPSКомпания EdgeCortix, по сообщению CNX Software, анонсировала ускоритель SAKURA-II Edge AI, предназначенный для выполнения ИИ-задач на периферии. Новинка, как утверждается, способна справляться с обработкой больших языковых моделей (LLM), больших визуальных моделей (LVM) и пр. В основу изделия положен нейропроцессорный движок с архитектурой Dynamic Neural Accelerator (DNA) второго поколения. Заявленная производительность достигает 60 TOPS на операциях INT8 и 30 Тфлопс на операциях BF16. Ускоритель может нести на борту 8, 16 или 32 Гбайт памяти LPDDR4x с пропускной способностью 68 Гбайт/с. Есть 20 Мбайт памяти SRAM. Заявленное типовое энергопотребление составляет 8 Вт. Изделие имеет упаковку BGA с размерами 19 × 19 мм. Диапазон рабочих температур простирается от -40 до +85 °C. Для ускорителя доступен программный комплект MERA с поддержкой PyTorch, TensorFlow Lite и ONNX. Помимо собственно ускорителя SAKURA-II Edge AI, компания EdgeCortix представила решения на его основе. Это, в частности, модуль формата M.2 2280: он использует интерфейс PCIe Gen 3.0 x4, а энергопотребление равно 10 Вт. Доступны модификации с 8 и 16 Гбайт памяти LPDDR4. Стоят такие модули $249 и $299. Кроме того, выпущены однослотовые низкопрофильные карты расширения с интерфейсом PCIe 3.0 x8. Такие устройства существуют в вариантах с одним и двумя чипами SAKURA-II Edge AI. Во втором случае производительность удваивается и достигает 120 TOPS на операциях INT8 и 60 Тфлопс на операциях BF16. Младшая версия оснащена 16 Гбайт памяти и имеет энергопотребление 10 Вт. Старший вариант несёт на борту 32 Гбайт памяти и обладает энергопотреблением 20 Вт. Цена — $429 и $749 соответственно.

08.05.2024 [12:50], Сергей Карасёв

IBM представила небольшой сервер POWER S1012 для ИИ-вычислений на периферииКорпорация IBM анонсировала компактный сервер POWER S1012 на платформе POWER10, предназначенный для решения ИИ-задач на периферии. Новинка будет предлагаться в двух вариантах исполнения — в корпусе башенного типа и в виде системы формата 2U половинной ширины, что позволит размещать в стандартной стойке два устройства бок о бок. Решение оснащается модулем POWER10 eSCM с одним, четырьмя или восемью ядрами (3,0–3,9 ГГц) и 256 Гбайт памяти. Каждое ядро способно выполнять до восьми потоков инструкций одновременно (SMT8), благодаря чему максимальная конфигурация обеспечивает до 64 потоков. Заявленная пропускная способность памяти — до 102 Гбайт/с.

Источник изображений: IBM Конфигурация POWER S1012 (Bonnell) может включать два слота PCIe 5.0 x8 или один слот PCIe 4.0 x16, а также дополнительный разъём PCIe 5.0 x8. Допускается установка четырёх накопителей NVMe U.2. По заявлениям IBM, в плане производительности новинка втрое превосходит сервер POWER S814, поддержка которого закончится буквально на днях. Модификация в формате 2U половинной ширины позволяет сократить пространство для оборудования до 75 % по сравнению со стоечным сервером POWER S1014 (4U). Применение POWER S1012 на периферии даёт возможность выполнять определённые ИИ-задачи непосредственно в точке получения данных, что снижает задержки и уменьшает нагрузку на сетевые каналы. Сервер POWER S1012 станет доступен у IBM и сертифицированных бизнес-партнёров 14 июня 2024 года. Клиенты смогут выбрать оптимальный для себя период поддержки в диапазоне от трёх до пяти лет. Кроме того, в зависимости от потребностей будут доступны дополнительные варианты обслуживания.

30.04.2024 [11:24], Сергей Карасёв

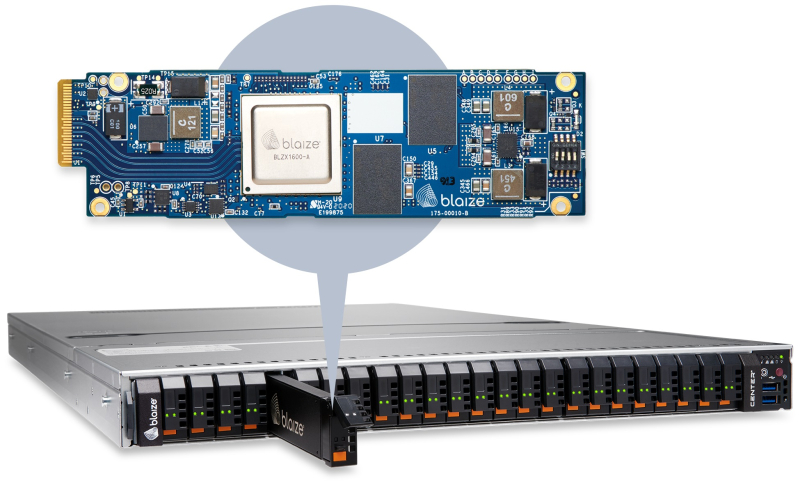

Разработчик ИИ-чипов для ЦОД и периферийных систем Blaize получил на развитие $106 млнСтартап в области ИИ Blaize объявил о проведении раунда финансирования, в ходе которого привлечено $106 млн. Деньги предоставили существующие и новые инвесторы, включая Bess Ventures, Franklin Templeton, DENSO, Mercedes Benz, Temasek, Rizvi Traverse, Ava Investors и BurTech LP LLC. Blaize разрабатывает специализированные чипы, предназначенные для ускорения выполнения ИИ-задач в дата-центрах и на периферии. Утверждается, что по сравнению с традиционными ускорителями на базе GPU и FPGA устройства Blaize обеспечивают более высокую энергетическую эффективность. В основе архитектуры решений Blaize лежит обработка графов, а многие модели ИИ можно как раз представить представить в виде графов. Платформа Blaize включает специализированное ПО Blaize AI Studio и Blaize Picasso SDK, предоставляющее клиентам удобные средства для быстрого создания и развёртывания ИИ-приложений. В ассортименте Blaize присутствуют различные ИИ-устройства на основе чипа Blaize 1600 SoC, содержащего 16 ядер GSP (Graph Streaming Processor). Заявленная ИИ-производительность достигает 16 TOPS. В частности, доступны модуль Blaize Xplorer X600M M.2 (PCIe 3.0 х4; 2 Гбайт LPDDR4), ускоритель Blaize Xplorer X1600E EDSFF (PCIe 3.0 х4; 4 Гбайт LPDDR4), карта расширения Blaize Xplorer X1600P PCIe (PCIe 3.0 х4; 4 Гбайт LPDDR4), ускоритель Xplorer X1600P-Q PCIe на базе четырёх чипов Blaize 1600 SoC (PCIe 3.0 х16; 16 Гбайт LPDDR4), встраиваемое решение Blaize Pathfinder P1600 Embedded System on Module, а также сервер Blaize Inference Server на базе 24 ускорителей Blaize Xplorer X1600E EDSFF. Привлечённые средства Blaize будет использовать для дальнейшей разработки и коммерциализации продуктов. В декабре 2023-го стартап сообщил о намерении выйти на биржу посредством SPAC-сделки с BurTech Acquisition Corp. Ожидается, что это позволит получить $71 млн при оценке компании в $894 млн.

29.02.2024 [12:17], Сергей Карасёв

Iceotope, HPE и Intel представили сервер KUL RAN второго поколения с СЖОКомпании Iceotope, HPE и Intel продемонстрировали на MWC 2024 ряд новинок для телекоммуникационной отрасли и edge-приложений. В частности, представлен сервер KUL RAN второго поколения с эффективной системой жидкостного охлаждения. Edge-сервер KUL RAN первого поколения дебютировал в июне 2023 года. Он предназначен для развёртывания vRAN-платформ, сетей 5G и других сервисов связи. Применена полностью автономная СЖО Iceotope Precision Liquid Cooling. Новая модель KUL RAN выполнена в форм-факторе 2U. В основу положен сервер HPE ProLiant DL110 Gen11 на базе Intel Xeon Sapphire Rapids. Iceotope заявляет, что устройство может эксплуатироваться в «самых суровых условиях». Оно имеет защиту от тепловых ударов, пыли и влаги. Диапазон рабочих температур простирается от -40 до +55 °C. Утверждается, что решение обеспечивает сокращение энергопотребления до 20 % по сравнению со стандартными телеком-серверами, тогда как частота отказов компонентов ниже на 30 %. Устройство KUL RAN второго поколения ориентировано на сети радиодоступа с низкими задержками и edge-задачи. Iceotope также заявляет, что её технология Precision Liquid Cooling даёт возможность охлаждать процессоры с показателем TDP 1000 Вт и даже выше. Таким образом, система подходит для применения в мощных ИИ-серверах с высокой нагрузкой.

НРЕ показала на MWC 2024 и другие системы для телекоммуникационной отрасли и инфраструктур связи 5G. Это, в частности, сервер ProLiant RL300 Gen11 со 128-ядерным Arm-чипом Ampere. Устройство типоразмера 1U оборудовано десятью фронтальными отсеками для SFF NVMe SSD с интерфейсом PCIe 4.0, тремя слотами расширения PCIe 4.0 и двумя слотами OCP 3.0.

15.12.2023 [00:30], Алексей Степин

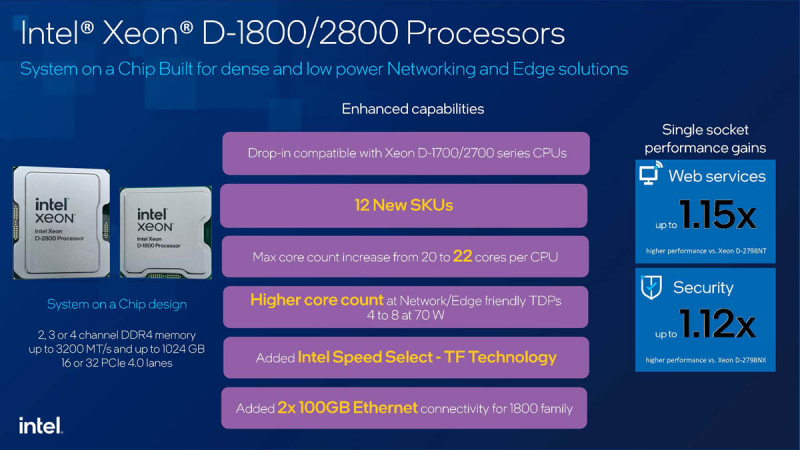

Intel представила процессоры Xeon D-1800/2800 и E-2400 для edge-систем и серверов начального уровняНаряду с анонсом процессоров Xeon Scalable пятого поколения компания Intel обновила и модельные ряды Xeon D и Xeon E. Изменений и нововведений в представленных чипах достаточно много. Так, модельный ряд Xeon D по традиции поделён на две ветви: Xeon D-1800 и Xeon D-2800. Уже сериии Xeon D-1700 и D-2700 были адаптированы для работы в серверах периферийных вычислений и в составе сетевого оборудования. Напомним ключевые моменты:

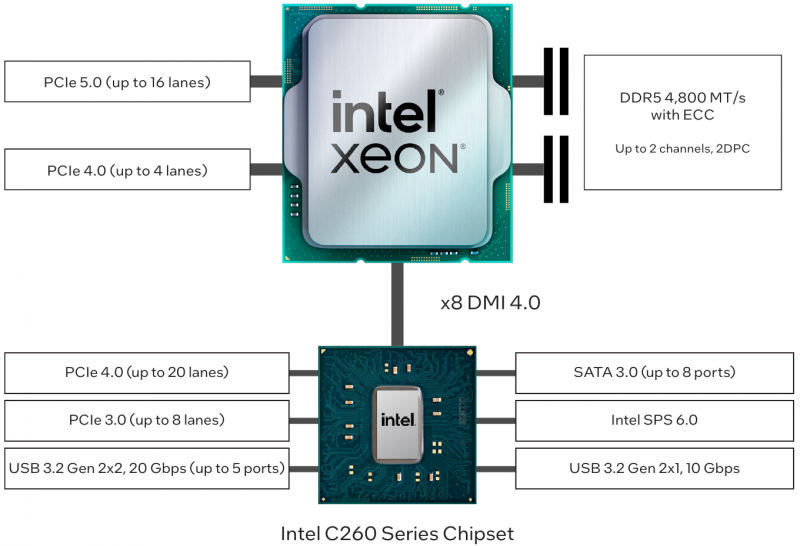

Всё это характерно и для новых Xeon D-1800 и D-2800, ведь в их основе лежит прежняя архитектура Ice Lake-D. Речь всё ещё идёт о сочетании DDR4 и PCI Express 4.0, однако улучшения всё же есть: оптимизация техпроцесса позволила довести максимальное количество ядер до 22 против 20 у предыдущих моделей при неизменном теплопакете. Небольшой прирост производительности тоже есть — примерно 1,12-1,15х у старшей модели Xeon D-2800. Кроме того, процессоры Xeon D-1800, наконец, получили поддержку двух 100GbE-портов. Одновременно с анонсом новых Xeon D состоялся анонс серии Xeon E-2400, которая заменит Xeon E-2300. Изменений здесь существенно больше. Во-первых, платформа перебралась с LGA 1200 на LGA 1700, а на смену ядрам Cypress Cove пришли Raptor Cove. И хотя E-ядер в составе CPU нет, Intel почему-то решила не активировать поддержку AVX-512. Во-вторых, существенный апгрейд претерпела подсистема памяти: вместо двух каналов DDR4-3200 теперь доступна пара каналов DDR5-4800. Наконец, Xeon E-2400 получили поддержку PCI Express 5.0 — из 20 имеющихся процессорных линий 16 теперь способны работать именно в этом режиме. Подросла версия DMI с 3.0 до 4.0, а PCH новой платформы теперь предоставляет 20 линий PCIe 4.0 и 8 линий PCIe 3.0. Заодно с трёх до пяти выросло количество портов USB 3.2 Gen 2x2 (20 Гбит/с). Максимальное число ядер в новой серии Xeon E осталось прежним — их всё ещё восемь, но благодаря существенно более быстрой памяти и использованию техпроцесса Intel 7 Ultra производительность новинок в среднем в 1,3 раза выше, чем у предшественников. Базовая частота подросла до 3,5 ГГц, в турборежим частота доходит до 5,6 ГГц, но при этом теплопакет не выходит за рамки 95 Вт. Нацелены Intel Xeon E-2400 на рынок серверов и облачных систем начального уровня.

15.02.2023 [16:35], Владимир Мироненко

Промежуточное звено: Akamai объявила о запуске платформы Connected Cloud на базе LinodeПровайдер платформ доставки контента и приложений Akamai Technologies анонсировал сервис Connected Cloud, основанный на платформе Linode, приобретённой им в прошлом году. Connected Cloud представляет собой более распределённую альтернативу сервисам AWS или Azure. Также было объявлено о сниженной стоимости облачных вычислений за счёт более низкой платы за исходящий трафик благодаря «приведению экономики, подобной CDN, к облачной передаче данных». Akamai поставила целью заполнить нишу, образовавшуюся между предложениями гиперскейлеров и провайдеров периферийных вычислений. Компания считает, что современные приложения зачастую разделяются на ряд различных микросервисов. Во многих случаях эти микросервисы должны быть распределены по географически обширной территории, что создаёт потребность в вычислительных ресурсах, отличных от тех, которые предлагает большинство поставщиков традиционных облачных услуг. С одной стороны, по словам Akamai, есть гиперскейлеры, предлагающие мощные вычислительные сервисы в нескольких регионах. С другой стороны, есть провайдеры CDN, чьи сервисы менее масштабны и предназначены для использования в более крупных, но менее производительных периферийных вычислительных средах. Поэтому Akamai намерена создать инфраструктуру, занимающую промежуточное положение в этой иерархии.

Источник изображения: Akamai Akamai досталось 11 площадок Linode, но компания планирует увеличить их количество более чем вдвое в 2023 году, а также удовлетворить потребности «промежуточного» рынка, добавив более 50 объектов для «распределённых» вычислений, «чтобы перенести базовые возможности облачных вычислений в труднодоступные места, которые в настоящее время не в полной мере обслуживаются традиционными поставщиками облачных услуг». В частности, компания добавит к концу II квартала 2023 года три новых объекта в США и ещё 10 объектов по всему миру. Linode заявила, что к концу 2023 года они будут размещены в Индии, Бразилии, Индонезии, Японии, Швеции, Италии, Франции и Нидерландах. Компания сообщила ресурсу DCD, что эти объекты будут подключены к существующей сети Akamai CDN. Заказчикам будут доступны виртуальные машины и контейнеры, но в более в облечённом по сравнению с большими облаками варианте. Кроме того, компания поменяла цены на исходящий трафик, что снизит затраты компаний, которым необходимо регулярно перемещать свои данные в облако и обратно. Также Akamai занялась сертификацией своих площадок, что даёт больше возможностей для использования облачных вычислений компаниям из строго регулируемых отраслей. Наконец, компания создала партнёрскую программу, в рамках которой квалифицированные технологические партнёры будут обучаться развёртыванию приложений на новой платформе.

21.09.2022 [19:39], Алексей Степин

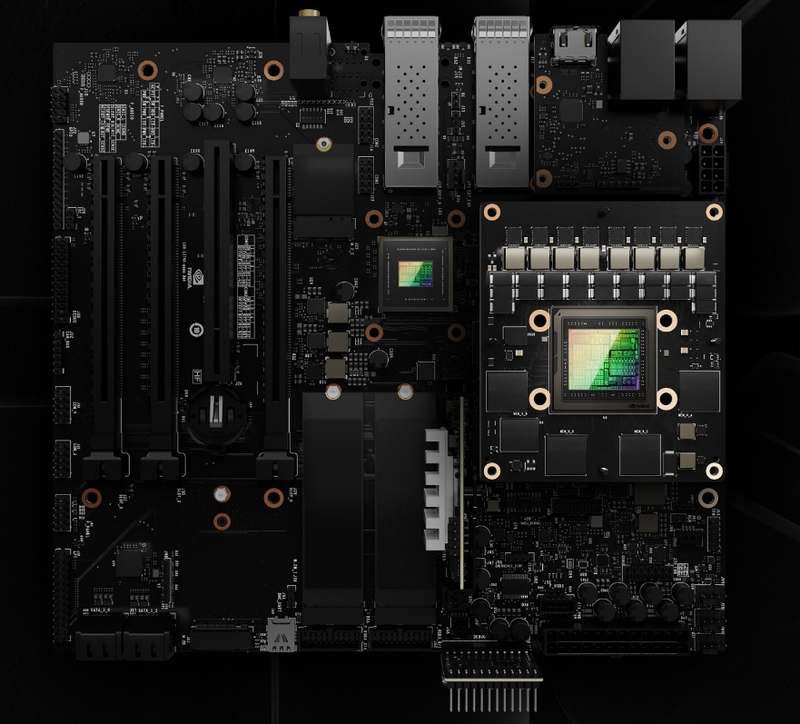

NVIDIA представила новые сверхкомпактные модули Jetson Orin NanoКомпания NVIDIA полна решимости занять лидирующие позиции на рынке робототехники: помимо новой платформы IGX, предназначенной для «умной» промышленности и медицины, на конференции GTC 2022 она представила и другие новинки в этой сфере. В частности, анонсированы новые модули в серии Jetson. Если в основу IGX лёг старший вариант, Jetson AGX Orin (Arm Cortex-A78AE + 1792 ядра Ampere + 56 тензорных ядер), то для более простых сценариев, требующих пониженного энергопотребления, он подходит не лучшим образом. Но именно для таких случаев предназначено пополнение серии — Jetson Orin Nano.

NVIDIA Jetson Orin Nano 8GB (слева) и 4GB. Здесь и далее источник изображений: NVIDIA Архитектурно Orin Nano похож на старшего собрата, но вычислительных ресурсов у него поменьше: 6 ядер Arm Cortex-A78AE и кластер GPC Ampere, состоящий из 1024 ядер CUDA и 32 тензорных ядер. Имеется отдельный процессор управления питанием, широко развиты подсистемы различных шин, от SPI, CAN и I2C до USB 3.2 Gen2, Ethernet и PCIe 3.0.

Архитектура процессора Orin Nano Доступны новые модули будут в самом начале следующего года по цене от $199, причём изначально компания планирует выпустить два варианта, с 4 и 8 Гбайт оперативной памяти LPDDR5. Старший вариант будет сконфигурирован в рамках теплопакета 7–15 Вт, его пиковая производительность в INT8 составит 40 Топс. Младший вариант с усечённой вдвое конфигурацией GPU будет ограничен 5–10 Вт и 20 Топс.

Характеристики семейства Jetson Orin Nano Модули Orin Nano совместимы по контактам с Orin NX и имеют тот же форм-фактор, 70 × 45 мм SODIMM, но за счёт использования более продвинутой архитектуры в задачах инференса новинки могут опережать предшественников в 80 раз. Благодаря обновлению фирменного SDK начать разработку приложений под Orin Nano заказчики смогут уже сейчас, пусть и в режиме эмуляции.

21.09.2022 [01:10], Алексей Степин

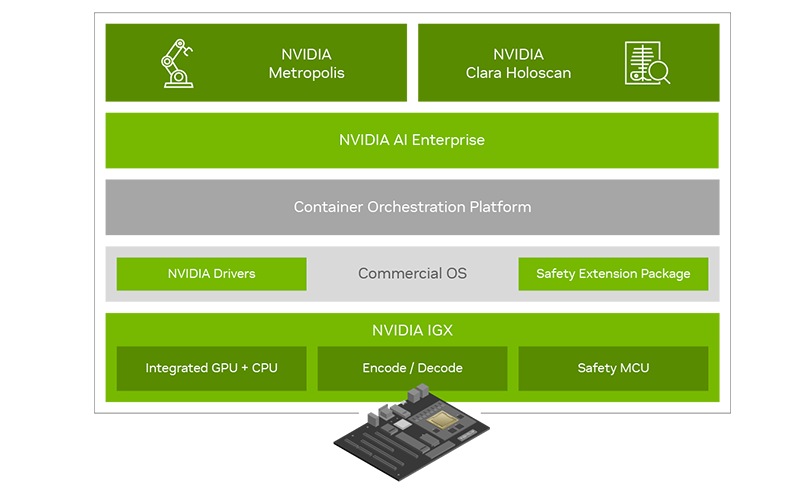

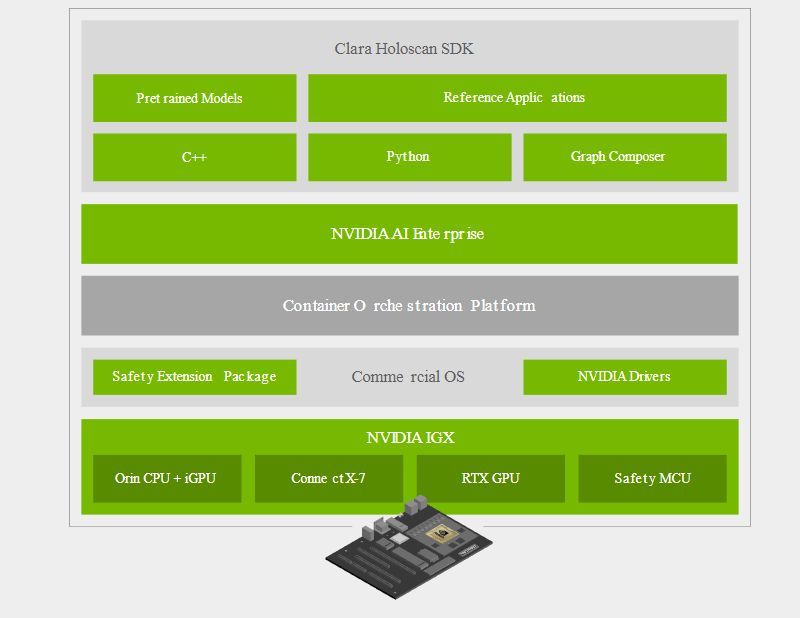

NVIDIA представила платформу IGX для «умной» промышленности и медициныПомимо новых GPU с архитектурой Ada компания NVIDIA на конференции GTC 2022 анонсировала множество новинок и не последней из них стала новая периферийная платформа IGX, призванная вывести «умную» промышленность на новый уровень. Главный упор в IGX сделан на обеспечении повышенной безопасности, причём как информационной, так и физической. Использовать совместный труд роботов в промышленности пытаются уже давно, но до недавних пор такие решения были нестандартными и весьма дорогостоящими. IGX призвана обеспечить безопасность, стандартизацию и высокий уровень производительности, достаточный для современной робототехники. Сердцем платформы IGX являются высокоинтегрированные модули серии Jetson AGX Orin, сочетающие в себе достаточно мощный процессор общего назначения, GPU-ускоритель, ускорители ИИ, машинного зрения, а также отдельный сопроцессор sMCU, отвечающий за обеспечение безопасности в проактивном режиме. Последний работает в комплексе с новыми программными расширениями, легко интегрируемыми в большинство коммерческих ОС благодаря сопутствующему программному стеку NVIDIA AI Enterprise.

NVIDIA IGX. Здесь и далее источник изображений: NVIDIA Что касается проактивной защиты, то, к примеру, получив сигнал с видеокамер о том, что человек приближается к «зоне ответственности» роботов, система автоматически изменит траекторию движения последних, предупредит сотрудников, а также на основании полученных данных скорректирует поведение роботов в дальнейшем. Также с помощью технологии «цифровых двойников» можно будет провести симуляцию, дабы заранее выяснить возможные точки потенциально опасных столкновений машин и людей.

NVIDIA IGX сделает подобные сценарии безопасными Производительность центрального модуля IGX составляет 275 Топс в режиме INT8. Обеспечение сетевых возможностей возложено на плечи современного сетевого адаптера ConnectX-7, гарантирующего прецизионные тайминги, позволяющие использовать платформу не только в промышленности, но и в медицине, где вопросы безопасности и точности жизненно важны. Естественно, индустрия нового поколения не может обойтись без унифицированных средств управления и обеспечения кибербезопасности. Весь комплекс решений на базе новой платформы IGX может развёртываться и управляться с единой консоли с помощью облачной системы NVIDIA Fleet Command. За безопасность при этом отвечает выделенный контроллер. На более высоком уровне за интеграцию новой платформы в единую экосистему отвечает фреймворк NVIDIA Metropolis, с помощью которого можно создавать по-настоящему крупномасштабные комплексы, включая целые «умные города».

Программно-аппаратный состав новой платформы Отдельного упоминания заслуживает то, что новая платформа NVIDIA IGX избрана в качестве основы разработчиками медицинских систем, в частности, цифровой и робо-хирургии, такими как Activ Surgical, Moon Surgical и Proximie. Это стало возможным как благодаря аппаратным свойствам платформы, таким как низкая латентность и гарантированное время отклика, так и сочетанию фреймворков MONAI и Clara Holoscan.  Первый позволяет обучать специфические ИИ-модели на основании массивов медицинских данных. Эти модели затем могут интегрироваться с помощью Clara Holoscan SDK в реальные системы ультразвукового сканирования, эндоскопии или робохирургии. Помимо встроенных средств ускорения IGX, Clara Holoscan поддерживает и внешние ускорители NVIDIA RTX A6000, а технология Rivermax обеспечит передачу видеоданных для робота-хирурга на скорости 100 Гбит/с прямо в набортную память GPU.  Комплекты разработчика IGX Orin будут доступны заказчикам в начале следующего года. Уже достигнуты соглашения с производителями встраиваемого оборудования ADLINK, Advantech, Dedicated Computing, Kontron, Leadtek, MBX, Onyx, Portwell, Prodrive Technologies и YUAN; уже испытывает новинку в деле Siemens. Также NVIDIA сотрудничает с Canonical, Red Hat и SUSE в целях обеспечения долговременной поддержки платформы, срок которой составит не менее 10 лет.

16.04.2022 [23:54], Алексей Степин

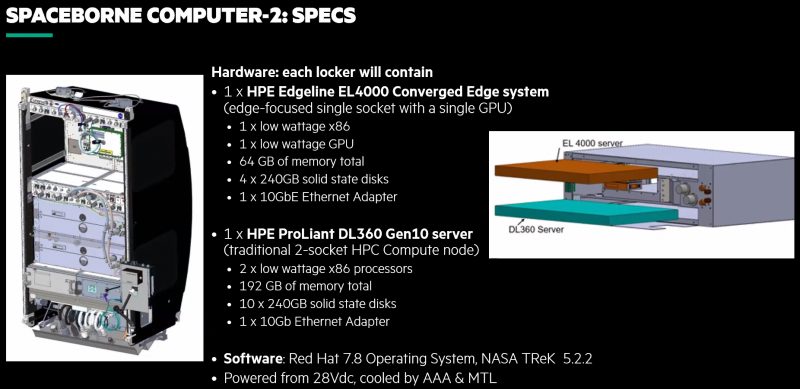

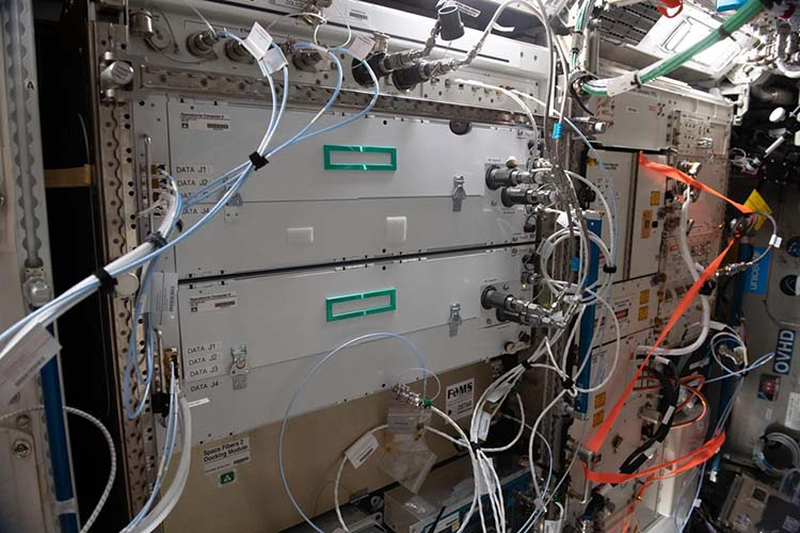

Космический суперкомпьютер HPE Spaceborne-2 успешно завершил 24 эксперимента на МКСПериферийные вычисления подразумевают работу достаточно мощных серверов в нестандартных условиях. Казалось бы, 400 километров — не такое уж большое расстояние. Но если это высота орбиты космической станции, то более «периферийное» место найти будет сложно. А ведь если человечество планирует и далее осваивать космос, оно неизбежно столкнётся и с проблемами, свойственными космическим ЦОД. Первый космический суперкомпьютер, как его окрестили создатели из HPE, появился в 2017 году и успешно проработал на орбите 615 дней. Инженеры учли выявленные особенности работы такой системы на орбите и в прошлом году отправили на МКС Spaceborne-2 (SBC-2), который стал вдвое производительнее предшественника. Хотя SBC-2 по земным меркам и невелик и состоит всего из двух вычислительных узлов (HPE Edgeline EL4000 и HPE ProLiant DL360 Gen10, совокупно чуть более 2 Тфлопс), это самая мощная компьютерная система, когда-либо работавшая в космосе. К тому же, это единственная космическая вычислительная система, оснащённая ИИ-ускорителем NVIDIA T4.

HPE Spaceborne-2 (Изображения: HPE) Теперь же HPE сообщает, что эта машина меньше чем за год помогла в проведении 24 важных научных экспериментов. Всё благодаря достаточно высокой производительности. Одним из первых стал стал анализ генов — обработка данных непосредственно на орбите позволила снизить объём передаваемой информации с 1,8 Гбайт до 92 Кбайт. Но это далеко не единственный результат. Так, ИИ-ускорители были задействованы для визуального анализа микроскопических повреждений скафандров, используемых для выхода в открытый космос. Они же помогли в обработке данных наблюдения за крупными погодными изменениями и природными катаклизмами. Также был проведён анализ поведения металлических частиц при 3D-печати в невесомости, проверена возможность работы 5G-сетей космических условиях, ускорены расчёты требуемых объёмов топлива для кораблей и т.д. Ряд проблем ещё предстоит решить: в частности, в условиях повышенной космической радиации существенно быстрее выходят из строя SSD, что естественно для технологии, основанной на «ловушках заряда». По всей видимости, для дальнего космоса целесообразнее будет использовать накопители на базе иной энергонезависимой памяти. Впрочем, при освоении Луны или Марса полагаться на земные ЦОД тоже будет трудно, а значит, достаточно мощные вычислительные ресурсы придётся везти с собой. |

|